多元线性回归

多元线性回归模型

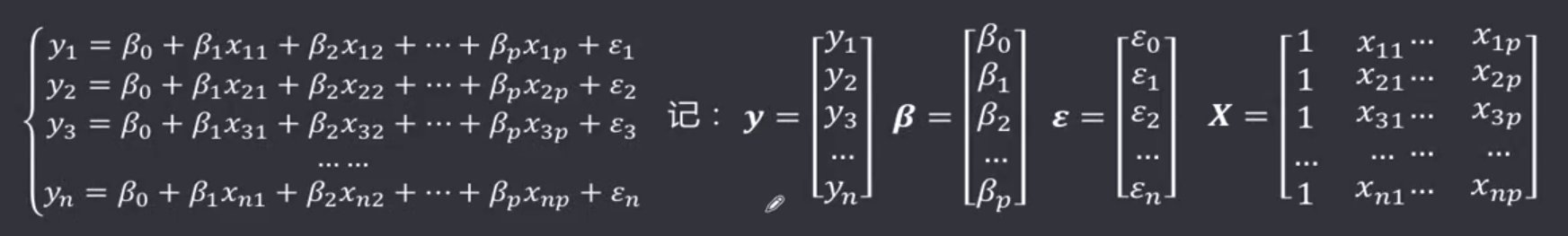

多元线性回归模型为:$y=\beta_0+\beta_1x_1+\beta_2x_2+…+\beta_px_p+\varepsilon$

其中$\varepsilon$为随机误差,满足:

- $E(\varepsilon)=0$

- $var(\varepsilon)=\sigma^2$

多元线性回归方程:$E(y)=E(\beta_0+\beta_1x_1+\beta_2x_2+…+\beta_px_p+\varepsilon)=>y=\beta_0+\beta_1x_1+\beta_2x_2+…+\beta_px_p$

多元线性回归方程的矩阵形式:

回归模型参数估计

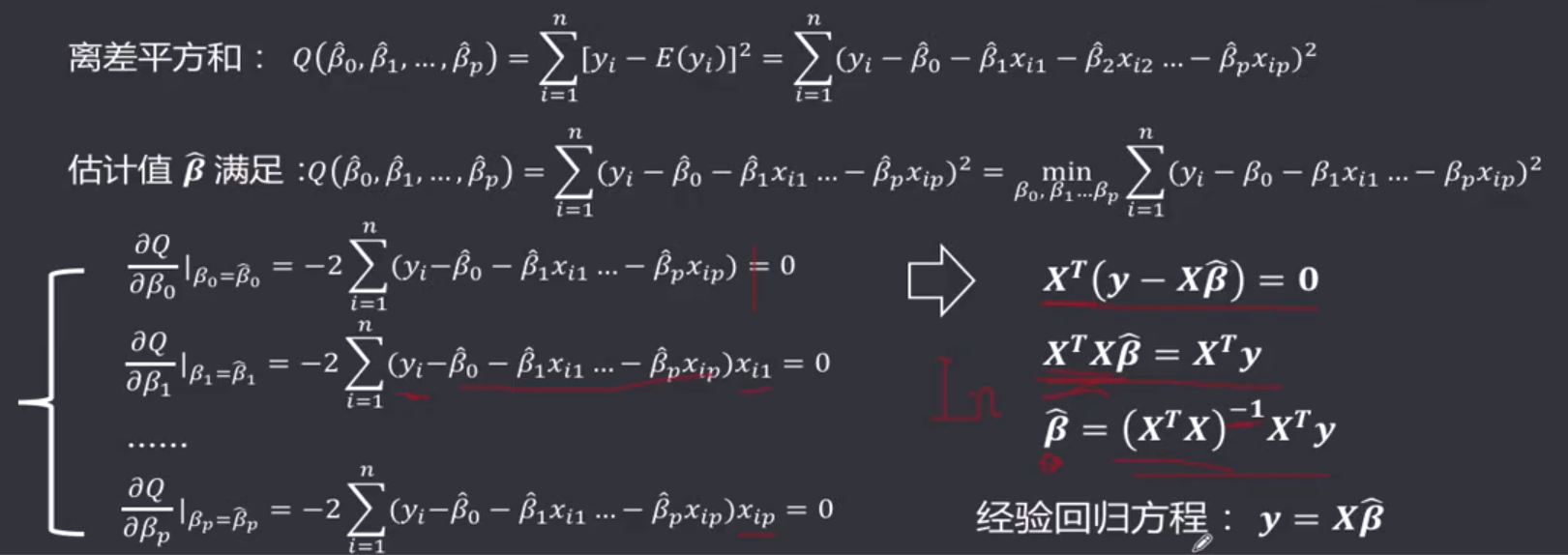

最小二乘估计

最小二乘估计(Least Square Estimation ,OLE):根据观察数据,寻找参数$\beta_0$,$\beta_1$的估计值$\hat{\beta_0}$,$\hat{\beta_1}$,使观测值和回归预测值的离差(离开正确值的差)平方和达到极小。估计值$\hat{\beta_0}$,$\hat{\beta_1}$称作回归参数$\beta_0$,$\beta_1$的最小二乘估计。

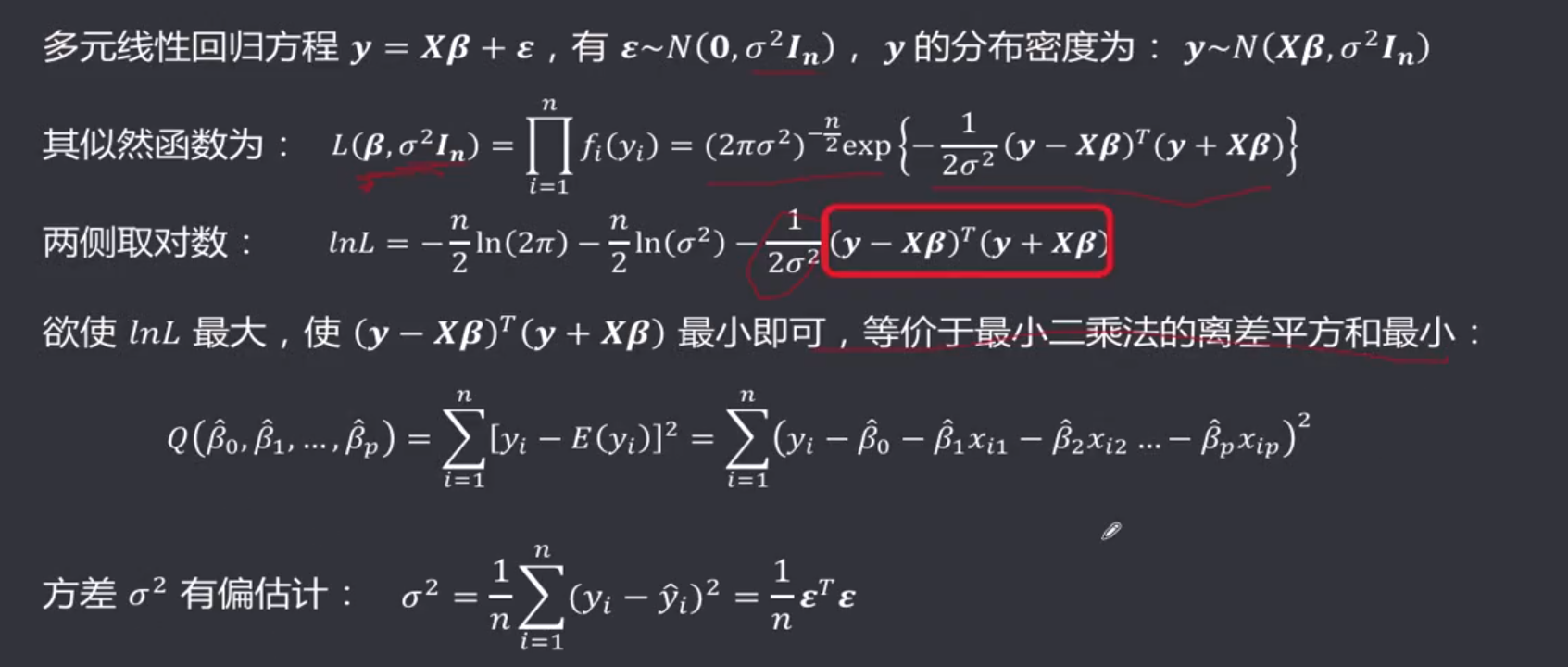

最大似然估计

回归模型的显著性检验

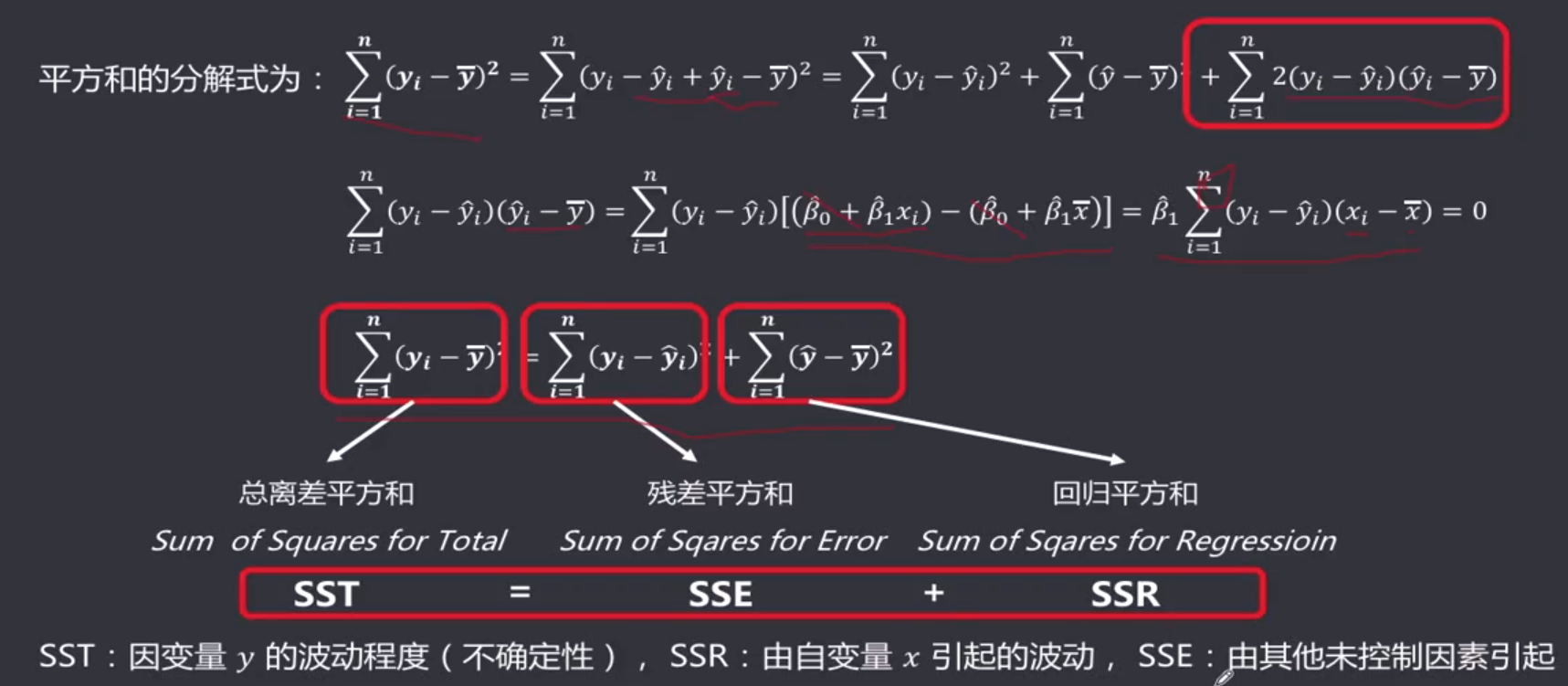

回归方程是否显著:F检验

F检验是根据平方和分解式,直接从回归效果检验回归方程的显著性。由平方和分解式可得到SSR越大,回归效果越好,据此构造F统计量。

- 确定假设:想检验自变量X对因变量Y是否有明显影响,即原假设$H_0: \beta_1=\beta_2… = 0$,备择假设$H_1: \beta_1 \ne 0$

- 确定检验水平:最常用的有$\alpha=0.05,\alpha=0.01,\alpha=0.005…$

- 计算统计量:计算自由度为(p,n-p-1)的F统计量

- 计算p值:根据F值计算p值(也可以直接去比较F值)

- 得到结论:p<$\alpha$或者$F>F_\alpha(p,n-p-1)$,拒绝原假设$H_0$,接受备择假设$H_1:\beta_1 \ne 0,\beta_2 \ne 0…$

回归系数是否显著:t检验

因变量y与自变量x之间是否存在线性关系,即$\beta_1$是否等于0,使用t检验进行判断。

- 确定假设:检验$x_j$对y是否作用显著,即原假设$H_{0j}: \beta_j = 0$,备择假设$H_{1j}: \beta_j \ne 0$

- 确定检验水平:最常用的有$\alpha=0.05,\alpha=0.01,\alpha=0.005…$

- 构造统计量:$H_0$成立时:$\hat{\beta_1}\sim N(\beta,\sigma^2(X^TX)^{-1}$,记$C=(X^TX)^{-1}$,构造t统计量:

- 根据t值计算p值(也可以直接去比较T值):计算t统计量,符合自由度n-p-1的t分布,双尾检测,查临界值表,找到p值

- 得到结论:p<$\alpha$或者$t>t_\alpha(n-p-1)$,拒绝原假设$H_{0j}$,接受备择假设$H_{1j}

t检验和F检验对多元线性回归来说不等价,F检验的目标时对所有自变量,t检验目标为单个自变量,即使F检验拒绝原假设,也不等于所有自变量都对因变量有影响,需要使用t检验去逐个验证。

自变量的标准化

多个自变量x的单位不同,其取值也不同,如果取值相差太大,会因计算误差问题导致回归方程结果不理想,需要对其进行标准化。

中心化:找到样本数据的中心$(\bar{x_1},\bar{x_2},,…,\bar{x_p};\bar{y})$,回归方程回经过这点,通过坐标变化,将原点移到该中心:

中心化后方程:

中心化不会改变回归线的斜率,只改变了直线的截距,所以\hat{\beta_0}中心化后变成了0,而其他的回归系数\hat{\beta_1},\hat{\beta_2},…,\hat{\beta_p}没有变化。

标准化:自变量单位不同,数据大小差异大,不利于在同一个标准上进行比较,为了消除量纲不同和数量级的差异带来的影响,将样本数据标准化处理,然后使用最小二乘法,得到标准化后的回归系数。

标准化公式为:$X_{ij}^\ast=\frac{x_{ij}-\bar{x_j}}{\sqrt{\frac{1}{n}\sum_{i=1}^n (x_{ij}-\bar{x_j})^2}}$

$y_{i}^\ast=\frac{y_{ij}-\bar{y}}{\sqrt{\frac{1}{n}\sum_{i=1}^n (y_{i}-\bar{y})^2}}$

标准化后方程: